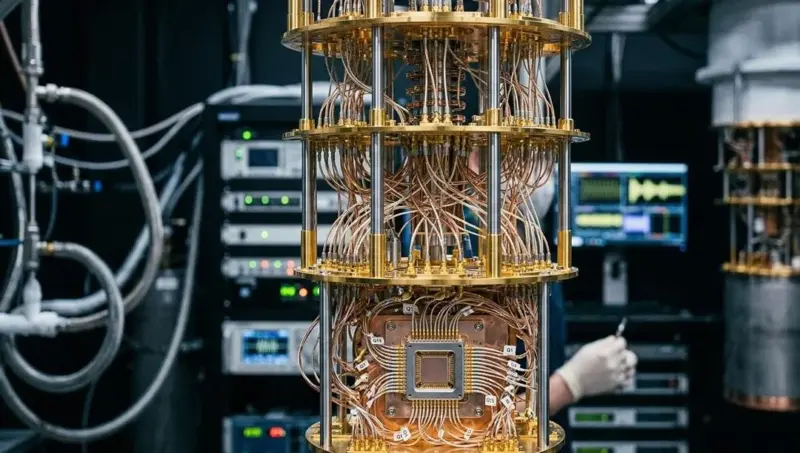

IBM revoluciona la computación con su arquitectura unificada cuántica y clásica

A mediados de marzo, IBM presentó una nueva visión para el futuro de la supercomputación: una arquitectura híbrida que combina la computación cuántica con la clásica. Esta iniciativa, denominada Supercomputación Centrada en la Cuántica (QCSC, por sus siglas en inglés), busca integrar procesadores cuánticos (QPU) con unidades de procesamiento clásicas como CPU y GPU, ya sean locales, en centros de investigación o en la nube. El objetivo es abordar problemas científicos extremadamente complejos que hasta ahora han estado fuera del alcance de los sistemas convencionales.

La propuesta de IBM no pretende reemplazar la computación tradicional, sino complementarla. Aunque la computación cuántica ya es una realidad, su desarrollo aún está en una fase temprana y no está lista para operar de forma aislada. En este contexto, la integración con sistemas clásicos resulta clave. La diferencia fundamental entre ambas tecnologías radica en su unidad básica de información: mientras los sistemas clásicos usan bits (que representan 0 o 1), los cuánticos emplean qubits, capaces de existir en una superposición de estados (0, 1 o ambos simultáneamente). Esta característica ofrece un potencial exponencial en el cálculo, pero también impone desafíos significativos en términos de diseño de software y coherencia del sistema.

Las tres fases de la supercomputación cuántica híbrida

Según IBM, la evolución de la supercomputación centrada en la cuántica se desarrollará en tres etapas bien definidas. La primera consiste en integrar los procesadores cuánticos como aceleradores especializados dentro de entornos de alto rendimiento (HPC), donde se encargan de resolver tareas específicas que requieren gran poder computacional, mientras el resto del flujo de trabajo sigue manejándose de forma clásica.

En la segunda fase, la conexión entre los sistemas cuánticos y clásicos se vuelve más estrecha gracias a software avanzado que reduce la latencia y mejora la comunicación entre ambos. Esto permite ejecutar algoritmos híbridos más complejos, en los que las tareas se distribuyen dinámicamente según la eficiencia de cada plataforma.

La tercera y última etapa apunta a una integración total, en la que las arquitecturas cuántica y clásica se diseñan conjuntamente desde cero. El resultado sería una plataforma unificada, capaz de gestionar de forma nativa flujos de trabajo híbridos, optimizando el uso de recursos y mejorando significativamente la eficiencia computacional.

Principales desafíos técnicos

- Corrección de errores y decoherencia: Los qubits son extremadamente sensibles a interferencias externas, lo que provoca la pérdida de información cuántica (decoherencia). Para mitigarlo, se requiere desarrollar qubits lógicos estables, una tarea que depende de sistemas de refrigeración criogénica cercanos al cero absoluto, costosos y complejos de mantener.

- Falta de talento especializado: La programación cuántica exige conocimientos profundos en física cuántica y lenguajes de programación específicos, lo que genera una escasez global de expertos capaces de desarrollar y operar estos sistemas.

- Integración de software: La necesidad de crear capas de software intermedias que permitan la transferencia eficiente de datos entre entornos clásicos y cuánticos representa un desafío clave en el desarrollo de aplicaciones prácticas.

IBM estima que el mercado de la computación cuántica podría alcanzar los 2.040 millones de dólares en 2026 y crecer hasta los 18.330 millones en 2034. A pesar de este potencial, el camino hacia la madurez tecnológica sigue siendo largo y complejo.

Aplicaciones reales y casos de éxito

La propuesta de IBM ya ha sido validada en entornos académicos y científicos. Instituciones como la Universidad de Oxford y ETH Zurich han utilizado este modelo híbrido para lograr avances significativos, como la creación y verificación de estructuras electrónicas de moléculas complejas y la simulación de mini proteínas compuestas por 303 átomos.

Otro ejemplo destacado es la colaboración entre el procesador cuántico IBM Quantum Heron y el supercomputador japonés Fugaku. Esta conexión permitió realizar una de las simulaciones más grandes hasta la fecha de cúmulos de hierro y azufre, gracias al intercambio dinámico de datos entre nodos clásicos y cuánticos.

Estos avances son solo el comienzo. Se espera que la supercomputación centrada en la cuántica tenga un impacto profundo en sectores como la farmacéutica, la química, las finanzas, la logística y la ciberseguridad. Además, abre las puertas al desarrollo de la inteligencia artificial cuántica (QAI), que podría revolucionar el procesamiento de datos y el aprendizaje automático en el futuro próximo.

Mira tambien: Descubren en Argentina al dinosaurio clave que revela los secretos de los terópodos

Descubren en Argentina al dinosaurio clave que revela los secretos de los terópodos La impactante transformación digital que hizo famoso al DANE

La impactante transformación digital que hizo famoso al DANE La IA me hizo comer así y los resultados fueron impactantes

La IA me hizo comer así y los resultados fueron impactantes Mi IA fue invitada a hablar en LinkedIn y luego la BANEARON

Mi IA fue invitada a hablar en LinkedIn y luego la BANEARON

Deja una respuesta